Напишу небольшую заметку как открыть и отредактировать большой json файл. Иногда приходится работать с файлами от 200 мбайт до гбайта. Не все редакторы их открывают, не говоря уже о редактировании и обьединении. Например, обычный блокнот и notepad++ вылетают еще при открытии. Поэтому для открытия часто пользуюсь Sublime Text 3.

Открытие больших файлов в Sublime

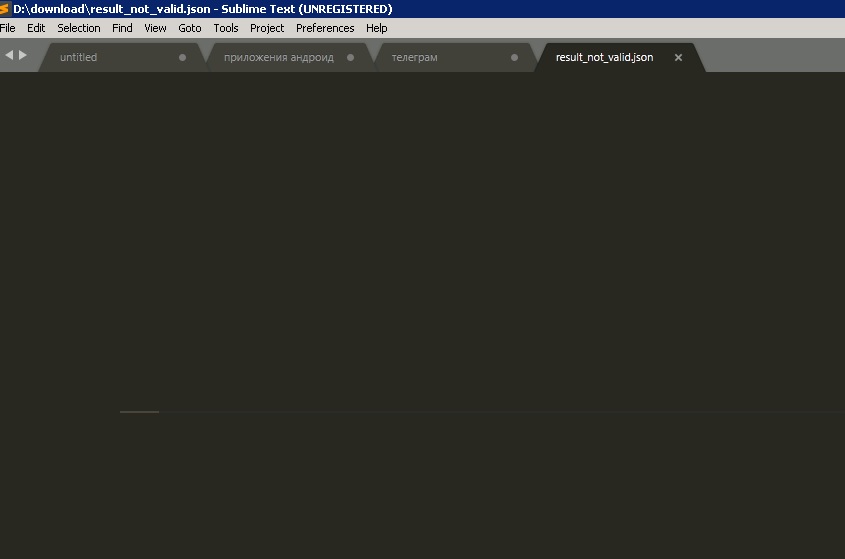

При загрузке json (или другого файла большого размера) можно увидеть полосу статуса открытия. То есть понять сколько времени ждать надо. Могу сказать, что файл 1,6 гбайт спокойно открылся, загружался примерно 2-3 минуты (на сервере с оперативной памятью 1 гбайт).

Но вот два файла в одном редакторе не смогло открыть, при чем один файл 250 мбайт, второй 490 мбайт. Сначала подождал пока загрузится файл что больше, потом хотел открыть на 250 — вылетело, и не один раз.

Редактирование больших файлов, замена, буфер обмена — вылетает

Также пытался сделать замену в большом файле или скопировать данные. Тестировал оба файла, но опишу даже для 250 мбайт-ового. Подождал открытие, потом хотел сделать замену двойных переносов — вылетело. При копировании в буфер всего содержимого тоже вылетает.

Если редактировать — то очень долго прогружает изменения, и бывает через время вылетает (естественно, без сохранения изменений).

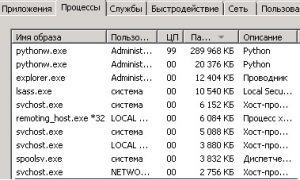

Поэтому редактирование и обьединение больших файлов я делаю в python. Как правило, все срабатывает, относительно долго открывает, обрабатывает, и грузит процессор (опять же, скрин с сервера с ОЗУ 1 гБайт).

Как обьединить два больших файла (json, csv, txt и другие)

Можно попробовать вариант через sublime text: открыть файл который меньше, скопировать содержимое и вставить в большой. Почти все новые ноутбуки и компьютеры имеют оперативную память больше 4 гбайт, должно быть у вас получиться.

Еще можно поискать как обьединить большие файлы онлайн. Но тут предлагают или .pdf файлы, или размер все таки ограничен (50-100 мбайт).

Я обьединял файлы через небольшой скрипт python. «Считывал» файл и дописывал в существующий файл. Это занимает какое-то время, по-другому рабочий вариант пока не придумал.

А как вы открываете и редактируете большие файлы? Как обьединяете, чем пользуетесь? Жду ваших ответов.

Если нужно объединить 2 или более больших файлов, даже если их размер больше ОЗУ, берется такой софт, как Penguin [BigData Editor], открываются все эти файлы. И сохраняются в 1 файл, и вуаля — проблема решена. Вообще, как по мне, лучше софта доя больших файлов тупо нет. В свое время перебрал все что только можно и могу с уверенностью сказать, что софт — топ. Ну и инструментов там просто куча для работы с такими файлами, при этом он настолько простой и понятный, что сходу понимаешь, как с ним работать. При чем даже если памяти всего пара гиг, а файл весит 20 гиг, никаких проблем с его обработкой не возникнет.

Только он платный :-)